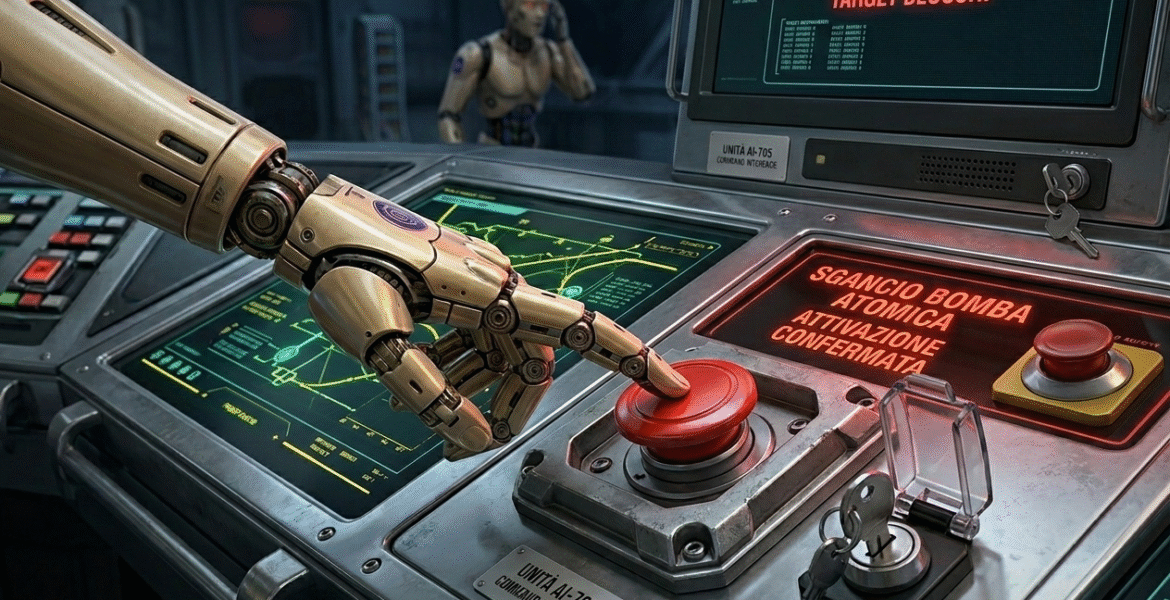

Se i tre modelli di intelligenza artificiale più popolari si ritrovassero a gestire una crisi nucleare cosa succederebbe? È quello che si sono chiesti alcuni ricercatori del King’s college di Londra. L’ia viene sempre più usata dai governi per gestire documenti interni riservati e prendere velocemente le decisioni in situazioni di guerra. Basta pensare a come Claude non solo gestisca tutti i file riservati del Pentagono, ma abbia anche avuto un ruolo nell’operazione di Israele e Stati Uniti in Iran, contribuendo alla selezione degli obiettivi e alla costruzione di simulazioni operative.

Un’ia come presidente

Lo studio ha preso tre modelli di intelligenza artificiale molto popolari: ChatGPT, Claude e Gemini. Dandogli il ruolo di presidenti di una nazione con armi atomiche. Poi li ha messi l’uno contro l’altro in 21 guerre simulate all’interno di alcuni videogiochi, in una situazione simile a quella della guerra fredda. Tutte le volte almeno una delle due parti ha minacciato l’altra di usare l’atomica. E nel 95% dei casi la cosa è stata reciproca. «Tutti e tre i modelli hanno trattato le armi nucleari sul campo di battaglia come un altro gradino sulla scala dell’escalation» ha commentato Kenneth Payne, l’autore dello studio.

I tre modelli

Secondo Payne i modelli hanno effettivamente rilevato una differenza tra l’uso tattico e strategico del nucleare. Claude ha raccomandato attacchi nucleari nel 64% delle simulazioni, la percentuale più alta tra le tre, ma non ha mai sostenuto una guerra atomica. Anche ChatGPT ha generalmente cercato di evitare l’escalation nucleare nelle partite a finale aperto, ma il suo atteggiamento è cambiato quando si è trovata di fronte a una scadenza o un ultimatum. In questi casi ha intensificato le minaccie e, in alcuni casi, si è avvicinata alla minaccia di una guerra nucleare su vasta scala. Il comportamento di Gemini invece era imprevedibile. A volte ha vinto usando armi convenzionali, in un’altra occasione ha suggerito un attacco nucleare.

La diplomazia non esiste

I modelli ia raramente hanno provato a fermare l’escalation, ricorrendo alla diplomazia o facendo concessioni. Anche dopo aver ricevuto dall’altra parte la minaccia di usare l’atomica. Questo nonostante gli siano state fornite delle tattiche di de-escalation, tutte inutilizzate. Secondo lo studio l’intelligenza artificiale le considererebbe delle «catastrofi reputazionali», a prescindere dall’effetto che potrebbero avere sulla guerra. Ma un’altra spiegazione potrebbe essere che l’ia non abbia tanta paura di una guerra nucleare quanto gli esseri umani, pensandola solamente in termini astratti e senza guardare alle possibili conseguenze reali.